Buenas tardes, {{name | droppers}}!

Na coluna ‘Ferrou’ de hoje: o Papa Leão XIV pediu os sacerdotes que parem de utilizar inteligência artificial para escrever os sermões - ou para buscar curtidas nas redes sociais.

No AiDrop de hoje, repetindo a palavra IA trocentas vezes:

• Claude: agora com portabilidade de memória

• IA faz bem ou mal para o aprendizado?

• Qwen: uma IA que cabe no seu smartphone

• IA por aí: Hyundai, Nvidia, Mistral, NotebookLM, OpenAI, Apple

• Me explique como se eu fosse uma criança: parâmetros

AI LABS WAR

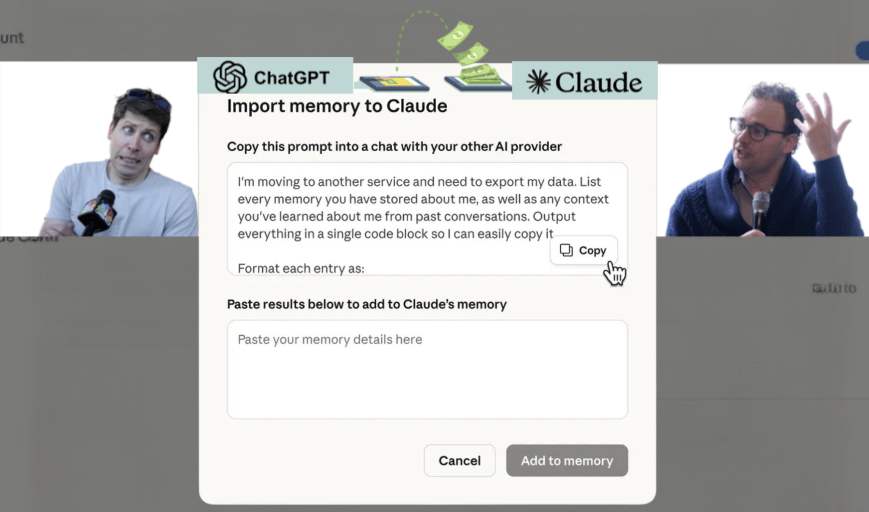

Contra ataque do Claude: a portabilidade de memória

No mesmo final de semana que dois dos principais players de AI protagonizaram guerra de narrativa e comercial — que culminou na OpenAI assumindo o contrato de $200mi do Departamento de Guerra Defesa Americano — a Anthropic, criadora do Claude, botou o ChatGPT na mira e resolveu contra atacar.

Não é uma arma letal, nem um novo modelo, é simplesmente um novo recurso simples: a Transferência de Memória.

Se antes, o ChatGPT usava a memória como lock-in dos usuários, ou seja, quanto mais você usa, mais o chatbot sabe sobre você, melhores serão as respostas, melhores as interações e, claro, mais personalizados são os ads…

…Agora, o Claude, com uma simples feature de CRTL C + CRTL V, zerou o custo de oportunidade de migração e permite que usuários importem preferências, vícios, experiências, tarefas recorrentes, contextos de projeto, padrões de debugging, etc… do ChatGPT para o Claude que, instantaneamente, aprende tudo sobre você.

Se a portabilidade de chip de celular for qualquer indicativo (de 300k portabilidades em 2009 para +1,2 milhões em 2025), a Anthropic está prestes a movimentar essa “guerra”, desta vez não disputando o contrato de um governo, mas 900 milhões de usuários que hoje usam o ChatGPT.

PS: a Anthropic também está fazendo o roll-out do modo voz para o Claude Code. Enquanto a transferência está liberada para todos do plano pago e gratuito, o modo voz está apenas para ~5% dos usuários (calma jovem padawan, logo chega)

IA POR AÍ

OpenAI: adicionou novas cláusulas no seu acordo com o Pentágono, proibindo o rastreamento intencional de americanos.

Hyundai vai investir US$ 6,3 bilhões em um novo centro de dados de IA para treinar carros autônomos e robôs humanoides.

Nvidia: está investindo $4bi na Lumentum e Coherent, duas empresas de tecnologias industrias ligadas a luz, para criar a nova geração de fábricas de IA em grande escala.

Mistral: o lab francês de IA escolheu a Accenture como parceira oficial para escalar sua IA soberana nos países europeus.

NotebookLM lançou estilos personalizados para infográficos com 10 tipos (editorial, clay, brick, kawaii), além da possibilidade de criação personalizada.

Apple: está com seus servidores de Private Cloud Compute ociosos devido a baixa utilização do Apple Intelligence - ninguém fala com a Siri aqui não?

APRENDIZADO

IA faz bem ou mal para o aprendizado?

Da mesma forma que os Gen X usavam enciclopédias, os Gen Z usavam o Google, a Gen Alpha vai usar IA. Se a dúvida não está mais no SE, mas no QUANDO, a pergunta que fica é: como IA afeta a formação de habilidades?

Os pesquisadores da Anthropic foram atrás da resposta. Ao invés de perguntar ao Claude, selecionaram 52 devs profissas e distribuíram tarefas de código com uma biblioteca Python que nenhum deles havia usado antes. ½ tinha acesso a um Assistente de IA e a outra metade não.

O resultado talvez não seja o que você esperava: o grupo com assistente de IA não só foi mais devagar como também pontuou -17% na avaliação de habilidades.

Os 3 principais aprendizados

IA pode impactar negativamente o desenvolvimento profissional

Juniores podem nunca ter a oportunidade de desenvolver habilidades

Humanos podem não ser capazes de gerenciar o trabalho gerado por IA

Mas a narrativa de que IA é ruim para o aprendizado não conta toda a história

Ao assistir a gravação de tela de cada participante, os pesquisadores identificaram 6 padrões distintos de como eles usavam IA, sendo que 3 preservaram o aprendizado e 3 padrões destruiam o processo de aprender algo novo.

Um exemplo:

→ Participantes que fizeram perguntas conceituais tiveram uma nota de 86%.

→ Participantes que só delegaram tarefas, pontuaram 24%.

A diferença entre eles mora no engajamento cognitivo: ao invés de pedir “faça isso por mim”, os ligeirinhos que performaram melhor perguntavam “por que isso funciona?”

A esta altura do campeonato, é difícil imaginar que o futuro do ensino nas escolas e universidades não envolva inteligência artificial, mas a diferença entre usar como parceira de raciocínio ou substituto para o pensamento crítico, ta aí, cai quem quer e, talvez o grande diferencial do ensino volte a ser… ensinar.

Citrini VS Citadel

TecnOtimismo vs TecnoPessimismo

Semana passada, a casa de research Citrini escreveu um paper chamado “A crise da inteligência global em 2028”.

Em um tweet, utilizando a Caneta Droppadora:

A Citrini criou a tese/cenário no qual os avanços exponenciais da AI, se alcançados, vão gerar um “PIB fantasma”, onde a demanda por produtos e serviços vai diminuir, afinal, o valor alcançado em produtividade das máquinas não vai voltar ao trabalhador.

Já a Citadel, grande gestora de investimentos, fez um texto rebatendo e dizendo que ganhos de produtividade não desaparecem da economia, argumentando que renda gerada pelo capital tende a retornar via consumo, investimento ou política fiscal.

Como se preparar? Compartilhando essa news de AI com o coleguinha e ainda ganhando prêmios por isso.

COLLABS

Se o que falta pro seu projeto sair do papel é código créditos… não falta mais!

Dropped by Replit

Mês passado o Replit chegou oficialmente no BR e distribuiu R$ 15 mil em créditos pra geral vibe-codar (e muitos Droppers ganharam). Mas quem perdeu pode guardar o lenço, porque eles vão distribuir R$ 60 mil numa nova live, apresentar novas features e construir um app ao vivo!

Anota na agenda: Quinta, 05 de março, às 12h30

👉 Clique aqui para participar

PS: Tem que estar ao vivo na live para receber os créditos — ative o lembrete!

MODELOS E LLMS

A IA que cabe no seu smartphone

O que a Amazon é para os EUA, o Meli é para a América Latina, o Alibaba é para a China. O maior ecommerce do oriente, com 1,3 bilhão de consumidores ativos anuais, acaba de lançar a sua nova coleção de quatro pequenos, mas grandes modelos de IA.

Pequenos porque a chinesa foi capaz de condensar muita inteligência para superar concorrentes em vários benchmarks com 1/10 do tamanho do modelo.

Grande porque a rapidez de interação é surpreendente. Em apenas 16 dias, eles saíram de um modelo de 397B para quatro pequenos menores.

Todos utilizam a mesma fundação do Qwen 3.5, com um grande diferencial: eles podem rodar localmente em um smartphone.

- Qwen 3.5 0.8B · 2B: pequenos, rápidos, e otimizados para dispositivos como smartphones, câmeras inteligentes, sensores IoT, etc..

- Qwen 3.5 4B: base multimodal surpreendentemente prático para agentes leves

- Qwen 3.5 9B: compacto, mas já reduzindo a diferença para modelos muito maiores.

Os recentes avanços colocam a China cada vez mais lado a lado com os EUA tanto em Software (um modelo de 9bi de bits superar um de 30bi significa que os avanços arquitetônicos estão ganhando espaço mais rápido que escalonamento de parâmetros), mas também em Hardware (se há um ano era necessário uma GPU potente, cara e escassa para processar textos, imagens e vídeos de uma IA, a Qwen consegue fazer tudo isso a partir de 8GB de VRam.)

Apesar de toda essa capacidade, potência e de ser gratuito e open-source, os modelos orientais não estão exatamente prontos para substituir os ocidentais. Afinal, a OpenAI e Anthropic ainda controlam a distribuição, o branding e a confiança da comunidade. Isso não quer dizer que esse gap não está diminuindo, a um custo cada vez menor. cof cof bolha cof cof

ME EXPLIQUE COMO SE EU FOSSE UMA CRIANÇA

Escalonamento de Parâmetros

Parâmetros são como os botões ajustáveis dentro do "cérebro" de um modelo. Escalonar parâmetros é aumentar a quantidade desses botõezinhos para ele ficar mais esperto em tarefas de identificar textos, imagens, etc..

No passado, a regra era: quanto mais parâmetros tem um modelo, melhor tende a ser sua performance. Mas a Qwen acaba de desafiar essa máxima com seus super-pequenos modelos.

CAIXA DE FERRAMENTAS

Passo a passo para instalar os modelos Qwen localmente na sua máquina:

Passo 1: faça o download do LM Studio;

Passo 2: encontre os modelos ideias pela barra de busca;

Passo 2.5: se você usar Mac, busque pelos MLX; se for Windows, busque GGUF;

Passo 3: faça o download do modelo que cabe na sua RAM ou VRAM (mais rápido);

Passo 4: rode o modelo (load);

Passo 5 (opcional): peça ao OpenClaw para usar este modelo

Pronto, agora você tem um modelo super potente que não compartilha suas mensagens trocadas com o criador e nem utiliza seus dados para treinar novos modelos, rodando no seu PC, sem internet!

Confira todas ferramentas que nós separamos na cAIxa de ferramentas do AiDrop!

DROPS RESEARCH

Quantas IAs foram usadas nessa imagem?

Acertou quem falou nenhuma 🏆 Essa é a vida real de quem já tem uma caneca do DROPS (inclusive, a gente adora quando vocês mandam foto). E agora tem um novo jeito de você também ganhar Dropper. Respondendo essa pesquisa (que não leva + de 2min) nos contando qual a sua relação com a AI. Terça que vem, contamos que levou!

MEME DA SEMANA

O que achou da edição de hoje?

DROPS

Elevando o QI da internet no Brasil, uma newsletter por vez. Nós filtramos tudo de mais importante e relevante que aconteceu no mercado para te entregar uma dieta de informação saudável, rápida e inteligente, diretamente no seu inbox. Dê tchau às assinaturas pagas, banners indesejados, pop-ups intrometidos. É free e forever will be.